AI技術の急速な普及により、私たちの生活は便利になった一方で、新たな人権侵害のリスクも浮上しています。採用活動でのスコアリング、顔認証による監視、生成AIを使った悪質な画像作成など、日本国内でも様々な問題が発生しています。

本記事では、実際に起きた10の事例を通じて、AI技術がもたらす人権侵害の実態と、企業や個人が取るべき対策について詳しく解説します。

採用・信用スコア等で不利益が生じた事例

この分野では、以下の2つの重要な事例を取り上げます。

- リクルートキャリアの内定辞退率推定サービスが行政指導を受けた事例

- ヤフーが信用スコアサービスを終了した事例

リクルートキャリアが行政指導を受けた事例

| 項目 | 内容 |

|---|---|

| 企業名 | 株式会社リクルートキャリア(当時) |

| 業界 | 人材サービス |

| ビフォー | 就活サイト等のデータを活用し、学生の「内定辞退率」を推定・事業者へ提供 |

| アフター | 個人情報保護委員会から指導等を受け、当該提供を停止。再発防止策の公表・運用見直し |

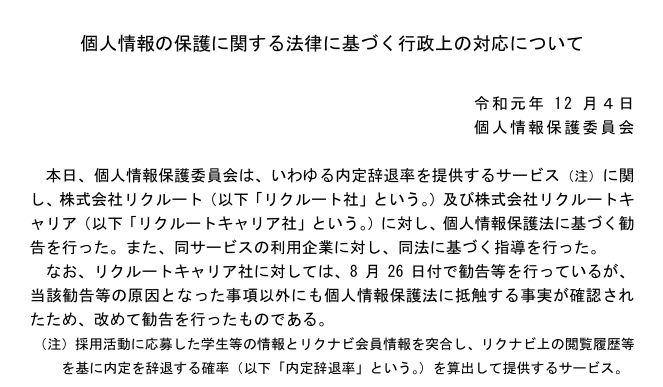

リクルートキャリアは2019年、就職活動サイトの閲覧履歴などから学生の「内定辞退率」を算出し、企業に提供していました。しかし、この仕組みには重大な問題が。学生本人への十分な説明や同意取得が行われておらず、個人情報の第三者提供に関する透明性に欠けていたのです。

個人情報保護委員会は同年8月と12月に勧告・指導を実施。スコアが採用判断に影響することで、学生の就業機会の公平性を損なう人権リスクが指摘されました。企業側は即座にサービスを停止し、告知方法の見直しや体制整備などの再発防止策を公表。

この事例は、AIアルゴリズムによる推定値の第三者提供が実務に与える影響を可視化した、国内の代表的な事例となっています。

ヤフーが信用スコアサービスを終了した事例

| 項目 | 内容 |

|---|---|

| 企業名 | ヤフー株式会社(当時、現:LINEヤフー) |

| 業界 | ポータル/プラットフォーム |

| ビフォー | 「Yahoo!スコア」を外部提供可能な形で開始(のち、デフォルト挙動を見直し) |

| アフター | 2020年8月31日でサービス終了。同意済みスコアも削除を公表 |

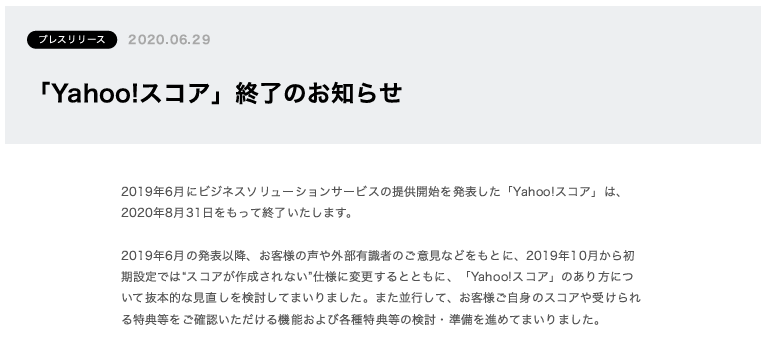

ヤフーは2019年に「Yahoo!スコア」という信用スコアサービスを開始しましたが、わずか1年余りでサービス終了に追い込まれました。当初は外部企業への提供も可能な設計でしたが、社会的な懸念の高まりを受けて方針転換を余儀なくされたのです。

問題の核心は透明性と本人関与の不足でした。ユーザーに対する十分な説明がないまま、個人の行動データから算出されたスコアが外部提供される可能性があったため、プライバシー侵害への懸念が拡大。最終的に同社は2020年6月にサービス終了を発表し、8月には既存のスコアも含めて完全削除を実施しました。

この事例は、信用スコア提供におけるリスクコミュニケーションの難しさを浮き彫りにし、他社のスコアリング実務にも大きな影響を与えた国内の重要な節目となっています。

位置情報・属性推定・監視によるプライバシー侵害事例

この分野では、以下の2つの事例を取り上げます。

- GO株式会社が車内タブレットでの性別推定で行政指導を受けた事例

- JapanTaxiアプリが位置情報の広告利用を停止した事例

GO株式会社が車内タブレットでの性別推定で行政指導を受けた事例

| 項目 | 内容 |

|---|---|

| 企業名 | GO株式会社(当時の車内タブレット広告サービス) |

| 業界 | モビリティ×広告テック |

| ビフォー | 端末内でカメラ画像を用い性別推定(画像は即時削除・保存なしという認識) |

| アフター | 個人情報保護委員会から「わかりやすい説明・適正取得・利用目的の通知・公表」を指導。表示・規程整備・ISMS取得などの対策を実施 |

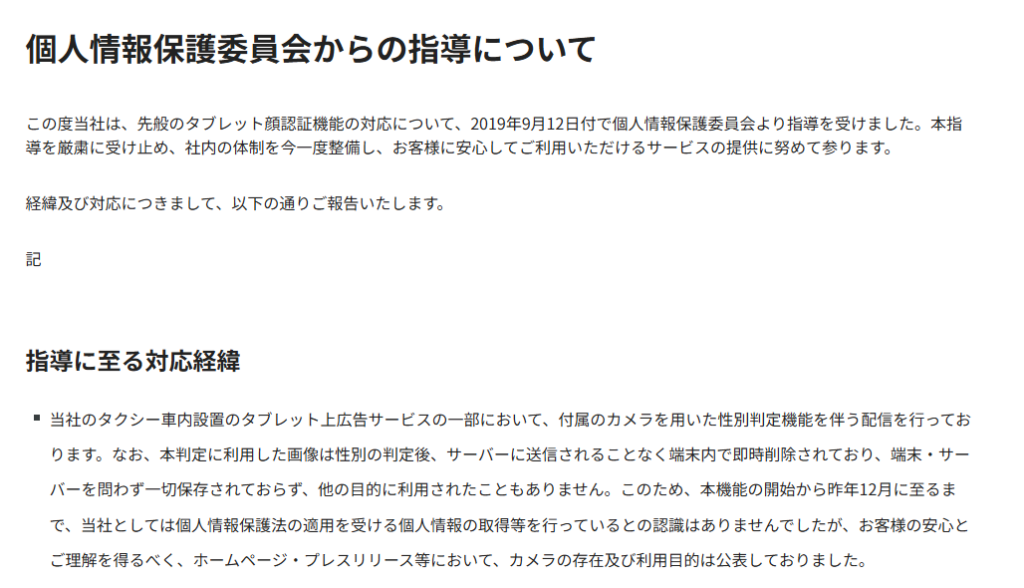

GO株式会社は2019年、タクシー車内のタブレット端末で乗客の性別を推定し、属性に応じた広告を配信するサービスを提供していました。同社は「画像は端末内で即座に削除され、保存はしていない」と認識していましたが、個人情報保護委員会の見解は異なるものでした。

委員会は、たとえ即時削除であっても個人情報として適切な取扱いが必要であると指摘。特に、乗客への十分な告知や同意取得が行われていない点が問題視されました。この指導を受け、同社は車内での表示改善、プライバシーポリシーの見直し、ISMS(情報セキュリティマネジメントシステム)の取得などの対策を実施。

この事例は、AI技術による属性推定がたとえ瞬時の処理であっても、透明性と適法な同意が不可欠であることを示した重要な先例となっています。

JapanTaxiアプリが位置情報の広告利用を停止した事例

『JapanTaxi』アプリからの広告利用目的でのデータの取得・利用の停止及び位置情報データ全削除のお知らせ – 株式会社フリークアウト・ホールディングス

| 項目 | 内容 |

|---|---|

| 企業名 | JapanTaxi(現GO)/フリークアウト |

| 業界 | モビリティ/広告 |

| ビフォー | アプリの位置情報を広告目的で第三者へ提供(同意・説明が不十分と判断) |

| アフター | 2018年10月30日に広告利用の即時停止とSDK削除を公式発表、プライバシーポリシーから該当記載も削除 |

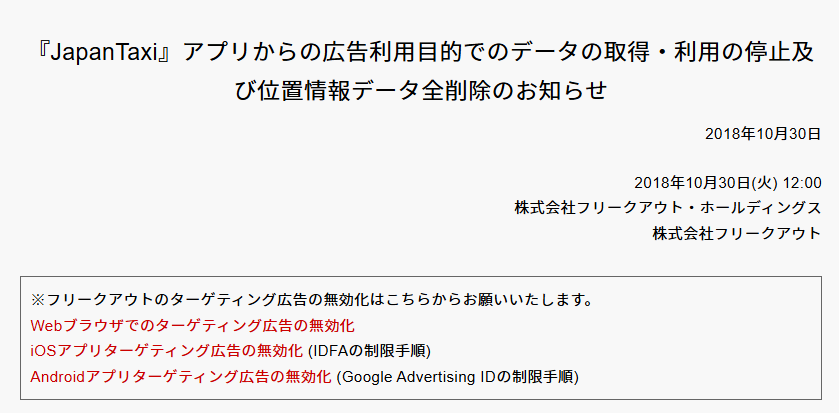

JapanTaxi(現GO)は2018年、アプリで取得した利用者の位置情報を広告配信会社のフリークアウトに提供していましたが、同年10月に即座にこの提供を停止しました。問題となったのは、ユーザーに対する説明と同意取得の不十分さです。

位置情報は個人の行動パターンや生活圏を詳細に把握できる高感度データにも関わらず、広告目的での利用について十分な透明性が確保されていませんでした。両社は自主的な判断として、広告利用の即時停止とSDK(ソフトウェア開発キット)の削除を発表。

プライバシーポリシーからも該当する記載を削除し、利用者への説明責任を果たす姿勢を示しました。この事例は、位置情報という機微な個人データを広告目的で扱う際の同意設計とオプトアウト機能の重要性を浮き彫りにした事例として注目されています。

■少しでもAI・システム開発やPoCに興味があれば、まずはお気軽にご相談ください。目的・課題を伺ったうえで、弊社から手堅く進める方法・お見積りをお伝えさせていただきます。

AIシステム開発サービスのお問い合わせはこちら>>

AIシステム開発サービス概要資料のダウンロードはこちら>>

AIシステム開発サービスの詳細はこちら>>

AIシステム受託開発

相談だけで発注しなくても構いません。

公的セクターのAI運用不備による権利侵害リスク事例

三重県児童相談所がAI評価活用の不徹底で重大事案を招いた事例

| 項目 | 内容 |

|---|---|

| 企業名 | 三重県(児童相談所/県の取組) |

| 業界 | 行政(児童福祉・保護) |

| ビフォー | 虐待リスク評価のためのAI等の指標が整備されていたが、現場では評価活用が十分でない場面があった |

| アフター | 重大事案後、検証と報告。AI活用の在り方・運用体制の改善を含む提言・再発防止へ |

三重県の児童相談所では、児童虐待のリスク評価にAI技術を活用した指標システムが導入されていました。しかし2022年に発生した重大事案の検証で、現場でのAI評価結果の活用が不十分だったことが明らかになりました。

県の公式報告書によると、AI分析結果がほぼ活用されず、適切な判断に生かされていなかった実態が浮上。子どもの生命・安全に直結する領域で、AI支援ツールと人間の判断を適切に組み合わせる体制が機能していませんでした。この検証を受け、県は評価手順の見直し、職員研修の強化、責任体制の明確化などの再発防止策を策定。

AI導入は目的ではなく手段であり、組織運営やガバナンス体制の整備が前提であることを改めて示した事例として、他の自治体にも大きな教訓を与えています。

生成AIの有害利用による人権侵害事例

この分野では、以下の3つの深刻な事例を取り上げます。

- 愛知県警が生成AIわいせつ画像共有で逮捕した事例

- 警視庁が生成AIわいせつポスター販売で摘発した事例

- 教員グループが卒業アルバム写真からAI裸画像を生成した事例

愛知県警が生成AIわいせつ画像共有で逮捕した事例

生成AIで女児のわいせつ画像共有疑い、50代男逮捕、愛知県警 – 産経ニュース

| 項目 | 内容 |

|---|---|

| 企業名 | (該当なし:個人による違法行為の摘発事案) |

| 業界 | SNS/オンラインコミュニティ |

| ビフォー | 生成AIでわいせつ画像を作成しSNSグループで共有 |

| アフター | 愛知県警がわいせつ電磁的記録媒体陳列の疑いで逮捕(生成AI画像摘発は同県警で初) |

2025年6月、愛知県警は生成AIで作成したわいせつ画像をSNSグループで共有していた男性を逮捕しました。これは同県警として生成AI画像の摘発初事例として報道され、大きな社会的関心を集めました。

この事例の深刻さは、生成AI技術の手軽さが違法コンテンツの作成・拡散を著しく容易にしている点にあります。特に、未成年の様相を持つ画像の生成は、実在する人物でなくても重大な人権侵害(児童の権利侵害)に直結する問題です。

技術の進歩により、専門知識がなくても高品質な画像生成が可能となった一方で、その悪用リスクも格段に高まっています。この摘発を機に、各自治体では条例の強化や行政罰の導入が検討されるなど、生成AI悪用への法的対応が急務となっています。

警視庁が生成AIわいせつポスター販売で摘発した事例

生成AIでわいせつ画像 知識なしでも生産 サイトに「数万点出品」 | 毎日新聞

| 項目 | 内容 |

|---|---|

| 企業名 | (個人事案/捜査機関:警視庁) |

| 業界 | オンラインプラットフォーム/EC |

| ビフォー | 生成AIで作成したわいせつ画像ポスターをオークションサイトで販売 |

| アフター | 警視庁が2025年4月に逮捕(のち一部釈放・在宅捜査へ) |

2025年4月、警視庁は生成AIで作成したわいせつ画像のポスターをオークションサイトで販売していた容疑で4人を逮捕しました。この事案は「国内初」の生成AI悪用による商業的販売の摘発として注目を集めました。

報道によると、容疑者らは1枚5,000円程度で販売を行い、総額約1,000万円の売上があったとされています。法解釈上重要なのは、実在しない人物の画像であっても「わいせつ図画頒布」の適用対象となり得ることが実務で示された点です。

また、プラットフォーム側の出品審査やモデレーション機能では、AI生成コンテンツの検知が困難であることも浮き彫りになりました。逮捕者の一部は釈放後に在宅捜査となるなど、捜査・立件の実務面での課題も見えており、生成AI悪用への法執行体制の整備が急がれています。

教員グループが卒業アルバム写真からAI裸画像を生成した事例

『卒アル写真+AI=裸の画像を生成』教職員による子どもへの卑劣な性犯罪…新制度で防止できる?「下着泥棒は対象外」など課題も【日本版DBS】 | 特集 | MBSニュース

| 項目 | 内容 |

|---|---|

| 企業名 | (個人事案/関与:愛知県警・教育委員会) |

| 業界 | 教育 |

| ビフォー | 卒業アルバムの顔写真等からAIで裸画像を生成しグループ内で共有 |

| アフター | 県警が捜査、教育委員会が対応(報道) |

2025年6月から8月にかけて、愛知県や名古屋市の教員らが児童の卒業アルバム写真を使ってAIで裸画像を生成し、秘匿性の高いSNSで共有していた事件が発覚しました。この事案は教育現場内部でのAI悪用という点で、社会に大きな衝撃を与えました。

最も深刻なのは、教育者という立場にある者が、本来保護すべき児童の画像を悪用した点です。卒業アルバム等の学校資料へのアクセス権限を悪用し、児童の人格権やプライバシーを著しく侵害する行為を行いました。また、合成技術の容易さと小規模なコミュニティ内での拡散により、被害の発見と防止が困難だった実態も明らかに。

この事件を受け、学校現場でのデジタル画像管理の厳格化、職員向けの倫理研修強化、AI悪用防止に関するガイドライン策定などが急務となっており、教育委員会による抜本的な再発防止策の検討が進められています。

生成AIの悪用による被害事例

この分野では、以下の2つの事例を取り上げます。

- 生成AIでランサムウェアを作成し国内初の逮捕となった事例

- 著名人の合成音声を使った投資詐欺で被害が発生した事例

生成AIでランサムウェアを作成し国内初の逮捕となった事例

生成AIでランサムウェアを作成した容疑者の摘発事例を考察 | トレンドマイクロ (JP)

| 項目 | 内容 |

|---|---|

| 企業名 | (個人事案/捜査機関:警視庁) |

| 業界 | サイバー/IT |

| ビフォー | 対話型生成AI(非公式版等)を悪用してランサムウェアを作成 |

| アフター | 2024年5月27日に逮捕報道、同年10月25日に有罪判決(執行猶予)報道 |

2024年5月、警視庁は生成AIを悪用してランサムウェア(身代金要求型ウイルス)を作成した容疑で男性を逮捕しました。これは国内初の「生成AIでマルウェア作成」による摘発事例として大きく報道されました。

この事例が示す深刻な問題は、正規AIサービスのガードレール(安全機能)を回避する手法や、「非公式版ChatGPT」のような規制の緩いサービスの存在により、IT専門知識のない人でも悪質なコードを作成できるようになった点です。

容疑者は同年10月に有罪判決(執行猶予付き)を受けましたが、実際の被害は限定的でも、作成段階で「不正指令電磁的記録作成」等の犯罪が成立することが示されました。この事例を受け、企業ではプロンプト監査、AIモデルの選定基準見直し、海外の規制緩いサービスへのアクセス制限などの対策強化が急務となっています。

著名人の合成音声を使った投資詐欺で被害が発生した事例

AIを使ったフェイク動画・音声で 堀江貴文氏かたる投資勧誘 SNS投資被害で5260万円被害 | 特集 | ニュース | 関西テレビ放送 カンテレ

| 項目 | 内容 |

|---|---|

| 企業名 | プラットフォーム事業者(YouTube等)/詐欺グループ |

| 業界 | 広告/SNS |

| ビフォー | 合成音声・ディープフェイクで著名人になりすまし、広告→LINE等へ誘導 |

| アフター | NHKや在阪局が被害・手口を報道、警察庁も近似手口の注意喚起(ビデオ通話偽装) |

2024年以降、著名投資家の合成音声を使った偽広告による投資詐欺が社会問題化しています。関西テレビの報道では、個別事例で5,000万円超の被害が確認されるなど、深刻な消費者被害が発生しています。

この詐欺の手口は巧妙で、まずYouTube等のプラットフォームに著名人になりすました広告を配信し、興味を持った視聴者をLINE等のメッセージアプリに誘導する「二段構え」の仕組みです。プラットフォーム側の広告審査では、合成音声や映像の真偽判定が困難で、本人性の検証も不十分なため、詐欺広告が掲載されやすい状況となっています。

警察庁も類似手口として「ビデオ通話を悪用した偽警察官・検察官詐欺」の注意喚起を行うなど、生成AI技術を悪用した詐欺の多様化が進んでいます。各プラットフォーム事業者には、広告主の実在性確認強化や著名人検証システムの導入が求められています。

AI人権侵害の規制・基準を正しく理解する

AI技術による人権侵害を防ぐには、まず現在の規制や基準を正確に把握することが重要です。以下の5つのポイントを押さえておきましょう。

国内の主要規制・基準を把握する

日本におけるAI関連の規制は、個人情報保護法を中心として整備が進んでいます。個人情報保護委員会が公表している「個人情報保護法ガイドライン」では、AIによる自動処理や属性推定に関する具体的な取扱い方法が示されています。

また、内閣府の「人間中心のAI社会原則」や総務省の「AI利活用ガイドライン」など、各省庁が業界別の指針を策定。これらの文書には、人権尊重やプライバシー保護に関する基本的な考え方が明記されており、企業のAI導入時の判断基準となっています。

業界団体による自主ルールも重要で、特に金融や医療分野では詳細な運用指針が定められています。

海外規制の域外適用を確認する

EU一般データ保護規則(GDPR)やAI法(AI Act)は、日本企業であってもEU市民を対象とするサービスを提供する場合には適用される可能性があります。特にAI法では、高リスクAIシステム(採用、与信、生体認証など)に対して厳格な要件を課しており、違反時の制裁金は非常に高額です。

米国各州の規制も注視が必要で、カリフォルニア州消費者プライバシー法(CCPA)やニューヨーク州の採用技術監査法など、AI利用に関する規制が拡大中です。

これらの規制は頻繁に更新されるため、国際展開を行う企業は法務部門と連携した継続的な監視体制の構築が不可欠となっています。

監督機関・ガイドラインを活用する

個人情報保護委員会は、AI関連の相談窓口や事例集を提供しており、企業の実務担当者にとって貴重な情報源です。同委員会のQ&Aページでは、顔認証や行動分析などの具体的な技術について、個人情報該当性や同意取得の要否が詳しく解説されています。

業界別では、金融庁の「金融分野におけるAI活用に関する有識者会議」の報告書や、厚生労働省の医療AI関連ガイドラインなど、専門性の高い指針も充実しています。

これらの文書を定期的にチェックし、最新の解釈や運用方針を把握することで、コンプライアンスリスクを大幅に軽減できます。

国際基準に対応する

国連ビジネスと人権に関する指導原則(UNGP)は、企業がAI開発・運用において人権への影響を評価し、適切な措置を講じることを求めています。この原則に基づく人権デューデリジェンス(人権への影響調査)は、国際的なスタンダードとして定着しつつあります。

OECD AI原則では、AI システムの透明性、説明可能性、堅牢性などが重要な要素として挙げられています。これらの国際基準は法的拘束力はないものの、投資家や取引先からの評価基準として重視される傾向があります。

ESG(環境・社会・ガバナンス)経営の観点からも対応が求められています。

判例・行政処分事例を理解する

前述したリクルートキャリアの事例やGO株式会社の事例など、実際の行政指導や処分事例を詳細に分析することで、規制当局の判断基準を把握できます。これらの事例からは、単に法令を遵守するだけでなく、社会的な受容性や透明性の確保が重要であることが読み取れます。

海外では、AmazonやMicrosoftなどの大手IT企業が顔認証技術の提供を一時停止した事例や、採用AIでの差別的な結果により訴訟に発展した事例なども参考になります。

これらの事例を社内で共有し、同様のリスクが自社にないかを定期的に点検することが、予防的なリスク管理につながります。

人権リスクを事前に評価・低減する方法

AI導入前の段階で人権リスクを適切に評価し、低減策を講じることが最も効果的な対策です。以下の5つのアプローチを組み合わせて実施しましょう。

影響評価を実施する

人権影響評価(HRIA:Human Rights Impact Assessment)は、AI システムが人権に与える潜在的な影響を事前に特定・評価する手法です。特に採用、与信、監視システムなど、個人の重要な権利に影響する分野では必須の取り組みとなっています。

データ保護影響評価(DPIA:Data Protection Impact Assessment)も重要な手法の一つ。個人データの大規模処理や新技術の活用時に実施が求められ、プライバシーリスクの特定と軽減策の検討を行います。これらの評価は一度実施すれば終わりではなく、システムの変更や新機能追加の度に見直しが必要です。

評価結果は文書化し、関係者間で共有することで、組織全体のリスク意識向上にもつながります。

モデル評価・監視を運用する

AI モデルの性能監視は、技術的な精度だけでなく、バイアス(偏見)の検出も含めて実施する必要があります。特定の属性(性別、年齢、人種等)に対する不公平な判定が行われていないか、定期的にチェックすることが重要です。

モデルドリフト(時間経過による性能劣化)の監視も欠かせません。学習時のデータと実際の運用データに乖離が生じると、予期しない判定結果を招く可能性があります。

監視指標の設定、閾値の決定、アラート機能の実装など、技術的な仕組みを整備するとともに、異常検知時の対応フローも明確化しておきましょう。

データガバナンスを整備する

データの収集段階から利用目的を明確化し、必要最小限の原則に基づいて取得範囲を決定します。特に機微な個人情報(人種、思想、病歴等)を扱う場合は、厳格な同意取得プロセスが必要です。

目的外利用の防止策として、データアクセス権限の細分化、利用ログの記録、定期的な利用状況の監査などを実施。データの保存期間も適切に設定し、不要になったデータは確実に削除する仕組みを構築します。

第三者提供を行う場合は、提供先の選定基準、契約条項、提供記録の管理など、包括的なガバナンス体制が求められます。

人手関与・異議申立て機能を設計する

完全自動化された AI 判定には必ずリスクが伴うため、重要な決定については人間の最終確認を組み込むことが重要です。特に採用の合否判定、融資の可否決定、医療診断の支援などでは、AI の結果を参考情報として活用し、最終判断は人間が行う設計が望ましいとされています。

利用者からの異議申立てを受け付ける窓口の設置も必須要件。AI による判定結果に納得できない場合の救済手段を明確化し、迅速な対応体制を整備します。

申立て内容の分析結果は、システム改善のフィードバック情報としても活用でき、継続的な品質向上につながります。

ベンダー監査・契約条項を強化する

外部ベンダーが提供する AI サービスを利用する場合、ベンダーの技術基準、セキュリティ体制、コンプライアンス状況を定期的に監査することが重要です。特にクラウド型の AI サービスでは、データの保存場所、処理方法、第三者との共有範囲などを詳細に確認する必要があります。

契約書には、人権侵害が発生した際の責任分担、損害賠償の範囲、サービス停止時の対応などを明記。監査権の確保、違反時の契約解除条項、改善要求権なども盛り込み、リスクの適切な分散を図ります。

ベンダー側の AI 倫理方針や認証取得状況も選定基準として重視すべきポイントです。

AI人権侵害対策ならニューラルオプト

AI技術による人権侵害リスクの回避には、技術的な専門知識と実務経験の両方が不可欠です。株式会社ニューラルオプトは、世界的生成AI「ChatGPT」の開発に携わってきた知見を活かし、課題解決コンサルティングから実装まで一貫してサポートします。

単なるシステム開発ではなく、人権影響評価の実施、バイアス検出機能の組み込み、適切なガバナンス体制の構築など、「失敗リスクを最小化する」アプローチで支援いたします。

データサイエンスの専門性を活かした公平性指標の設定や、運用段階でのモニタリング体制整備も対応可能です。eBayの価格自動設定AIや手書き文字認識システムなどの実績を通じて培った、実践的なAI倫理対応のノウハウを提供します。

人権侵害リスクを抑えながらAI活用を進めたい企業様は、ぜひご相談ください。